丰色 鱼羊 发自 凹非寺

量子位 报道 | 公众号 QbitAI

搜集的全部新冠机器学习“看片”论文,一篇能用的都没有?!

就在“广州两名医务人员核酸检测呈阳性”的新闻再度牵动大家伙的神经之际,一项来自剑桥大学的新研究也在外网上点燃了炸药桶。

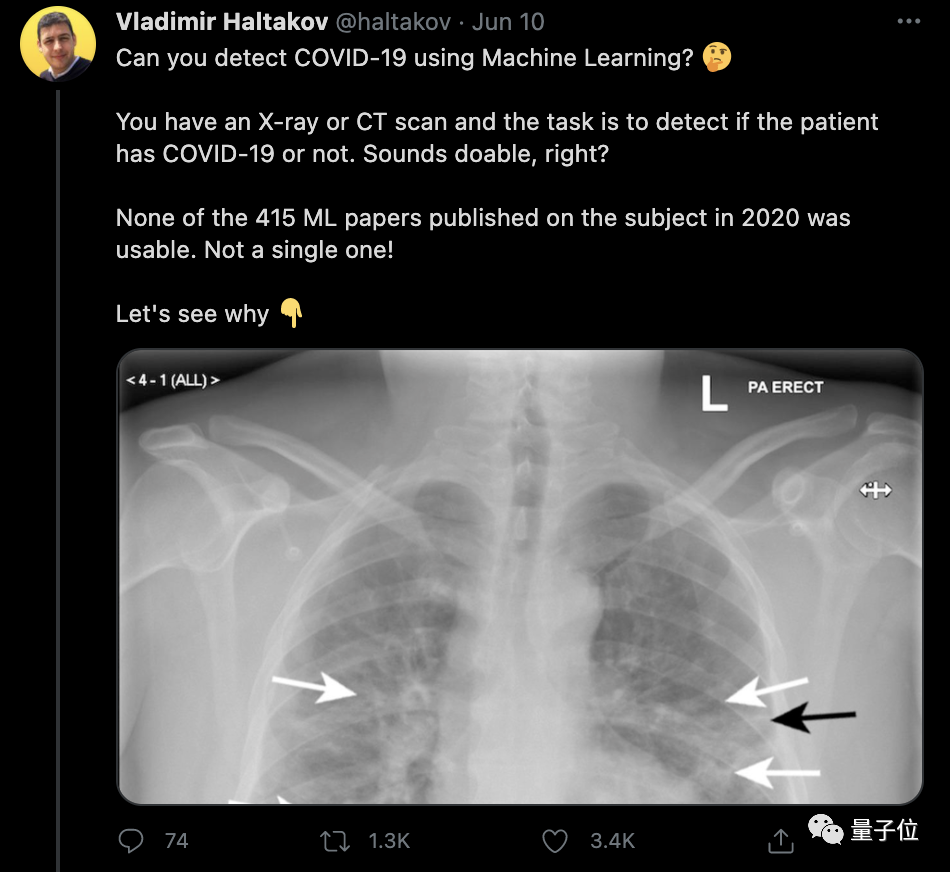

打从疫情之初,就有不少机器学习领域的研究人员,希望借助AI之力,帮助医务人员更好地保护自己:

去年1月到10月,就有2000多篇相关论文发表。

但是,就在AI比较成熟的看片领域,剑桥大学的结论却让人大跌眼镜:

搜集到的关于用AI进行新冠病毒医学图像检测、诊断的论文,都存在重大缺陷和偏差,没有临床使用的可能性。

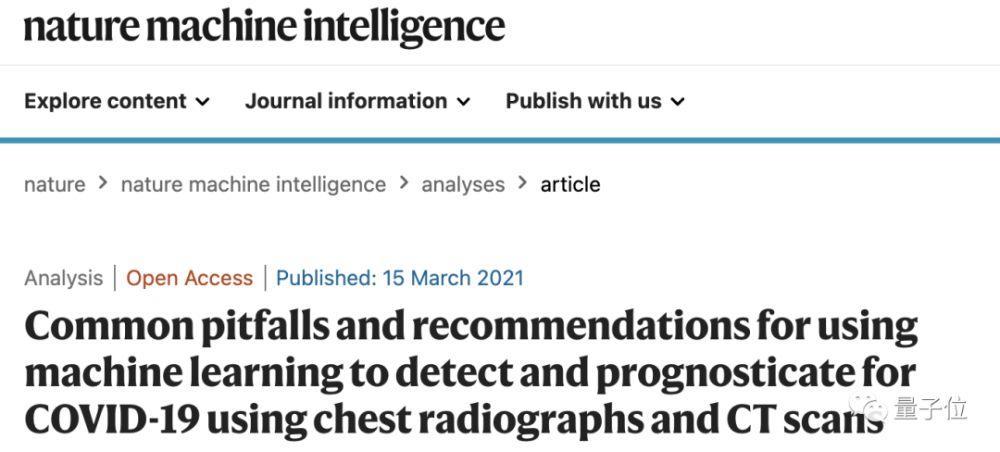

论文已发表在Nature Machine Intelligence上。

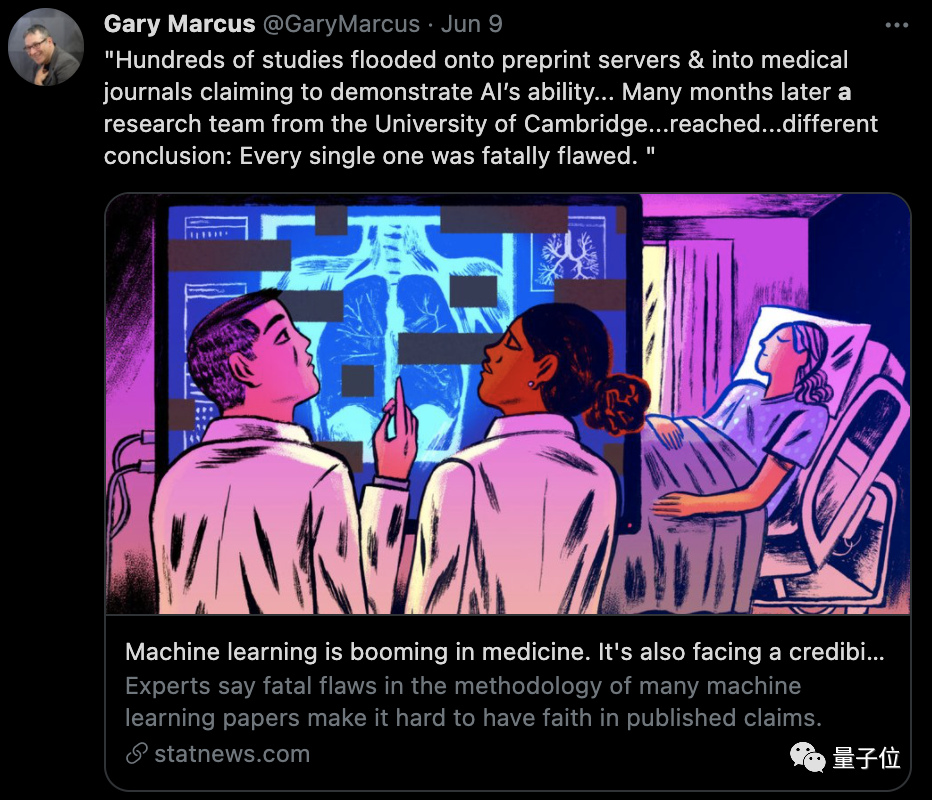

而如此“残酷”的结果,正可谓一石激起千层浪,专家学者纷纷转发讨论不说,也在社交媒体上引发了网友的热议。

有不少相关从业者表示:“这给我们上了重要的一课。”

究竟是怎么一回事?

为什么不能用?

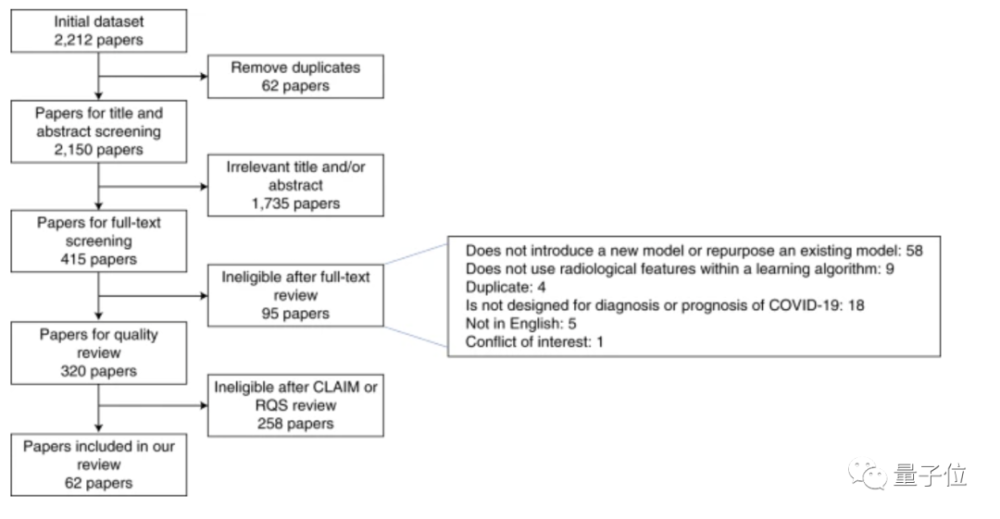

具体而言,剑桥大学的研究人员一开始在bioRxiv、medRxiv、arXiv等预印本论文平台,以及EMBASE和MEDLINE数据库中,按照“机器学习模型”、“CXR(胸部X光照片)/CT图像诊断、预测”这样的关键词,搜集到了2212项相关研究。

从中剔除掉缺乏外部验证、忽略了数据源或模型训练信息不完整的论文之后,通过初筛的论文有415篇。

而在进一步提高对论文的要求,比如排除掉RQS(放射性质量评分)

而这62篇,都没有潜在的临床应用价值。

对此,论文作者之一、来自剑桥大学医学部的James Rude博士表示:

国际机器学习界在帮助应对Covid-19流行病上做出了巨大的努力。这些早期研究让我们看到了一些希望,但它们在方法和报告(methodology and reporting)方面的缺陷非常普遍,我们审查的论文中没有一篇达到支持临床应用所必需的健壮性和可重复性。

在这62篇论文中,有55篇被发现由于各种问题而存在高偏见风险,包括依赖公共数据集,其中许多疑似阳性Covid-19的CT图像也没检测出来。

△每篇论文的数据指标

所有这些模型在研究中都看起来高度准确,一到临床就原形毕露(例如不同类型的患者或使用不同设备获得的成像扫描)。

这“全军覆没”的背后,主要还是数据集的问题。

其中许多模型都是在样本数据集极小的情况下训练的,有的数据还只来自一家医院,换个城市换个医院,这模型完全就不奏效了。

也有模型是基于公开的“Frankenstei数据集”来进行训练的。这样的大型数据集存在的问题是,随着时间推移,数据集不断发展、融合新的数据,这些变化很可能使得最初的结果无法复现。

更有甚者,训练和测试用的是同一个数据集。

当然,这也许不是研究人员存心这么做,由于法律和商业原因,很多医疗数据集都得保密,可供研究人员训练和验证的大型又多样化的数据真的很少。

这也导致医疗保健领域出品的机器学习研究特别难以复制,麻省理工就做过一项研究:

医疗AI论文复现率只有23%,而自然语言处理领域为58%,计算机视觉领域则达80%。

但数据集还只是一方面。其中也有方法设计不当和缺乏放射科医生和临床医生参与的问题。

例如,有模型的训练集采用儿童的CT图像作为“非Covid-19”数据、成人的作为“Covid-19”数据。

但实际上,在儿科就诊的儿童,在人体解剖结构上与成人有很大差异。这样的数据设置并不合理,训练出来的模型就会存在很大偏差。

“而无论大家是用机器学习来预测天气还是检测疾病,确保不同的专家在一起工作并说相同的语言很重要,这样才可以关注正确的问题。” 可惜的是,很多模型都没有让放射科医生和临床医生参与进来。

另外,时间限制也可以被解释为这一系列问题的“借口”。

“这些障碍都必须克服,不然就要面对信任危机”

当然,大量此类论文发表却全部无法应用的背后,说明这方面论文的审查制度也有问题,例如审稿人缺乏对机器学习的深入了解,或对知名机构或公司盲目信任等等,导致这些论文被草草通过。

但最重要是审稿机构缺乏一致的标准来评估医学领域的机器学习研究。剑桥大学的研究人员认为作者和审稿人之间需要建立一套共同的标准,确保研究真的解决了实际问题。

最后,尽管大量的Covid-19模型被发现无法复现应用于临床,剑桥大学的研究人员表示,经过一些关键的修改,这些机器学习模型还是可以成为抗击新冠的有力工具。

他们给出了一些总结和建议:

公共数据集可能导致严重的偏差风险,谨慎使用;

为了使模型适用于不同的群体和独立的外部数据集,训练数据应该保持多样性和适当的大小;

除了更高质量的数据集外,还需要可复现和外部验证的证明,这样才能增加模型被推进并整合到未来临床试验中的可能性。

并表示这些障碍都必须克服,不然人们对人工智能的信任将从何谈起?

此外由于隐私限制难以获取医疗数据,除了采取联邦学习,也可以参考一下最新发表在Nature封面上的联合学习 (Swarm Learning ),一项优于联邦学习的医疗数据共享技术。

AI看片到底行不行?

面对剑桥大学的结论,有网友感到忧心忡忡:

如今,AI/ML的价值和可信度正在被稀释。当我听到“AI解决方案”、“AI驱动”这样的字眼时,甚至会感到紧张。

也有网友认为,这与当下机器学习领域论文“灌水”之风不无关系。

但也有网友客观地分析,认为AI确实已经在医疗影像方面发挥了作用,只是它们替代不了医生,更多是在扮演医生的助手,并且目前,AI并没有办法去应对一些真正困难的情况。

而针对文章谈到的数据问题,有不少网友表示赞同:

数据并不是唯一的问题,但似乎是最直接的原因。

是时候为AI模型和数据集构建“蛋白质银行”这样的数据库了。

事实上,无论你对AI医疗是否持怀疑的态度,现在,至少像AI看片这样的医疗服务,已经真真切切来到了大众身边。

此前,量子位的同事就曾在中关村医院让AI给拍了一次CT。

而在与一线医生的沟通交流中,也有在三甲医院负责体检中心的主任医生向我们透露:如检测肺结节这样的单点应用,已经能够帮助医生减轻负担。

甚至还有放射科医生表示,“现在不用(AI辅助看片),还有点不习惯”。

Stat News则对此评论称:

机器学习在医疗领域蓬勃发展,同时也面临着信誉危机。

那么,你觉得AI医疗到底行不行呢?